ChatGPT, manipülasyona açık mı? Test sonuçları şoke etti!

ChatGPT, manipülasyona açık mı? Test sonuçla... OpenAI’nin yapay zeka modeli ChatGPT’nin arama özelliği, manipülasyona açık yapısı ve zararlı içerikler döndürebilme riskiyle tartışmalara yol açtı. Siber güvenlik uzmanları, dikkatli kullanım çağrısında bulunuyor.

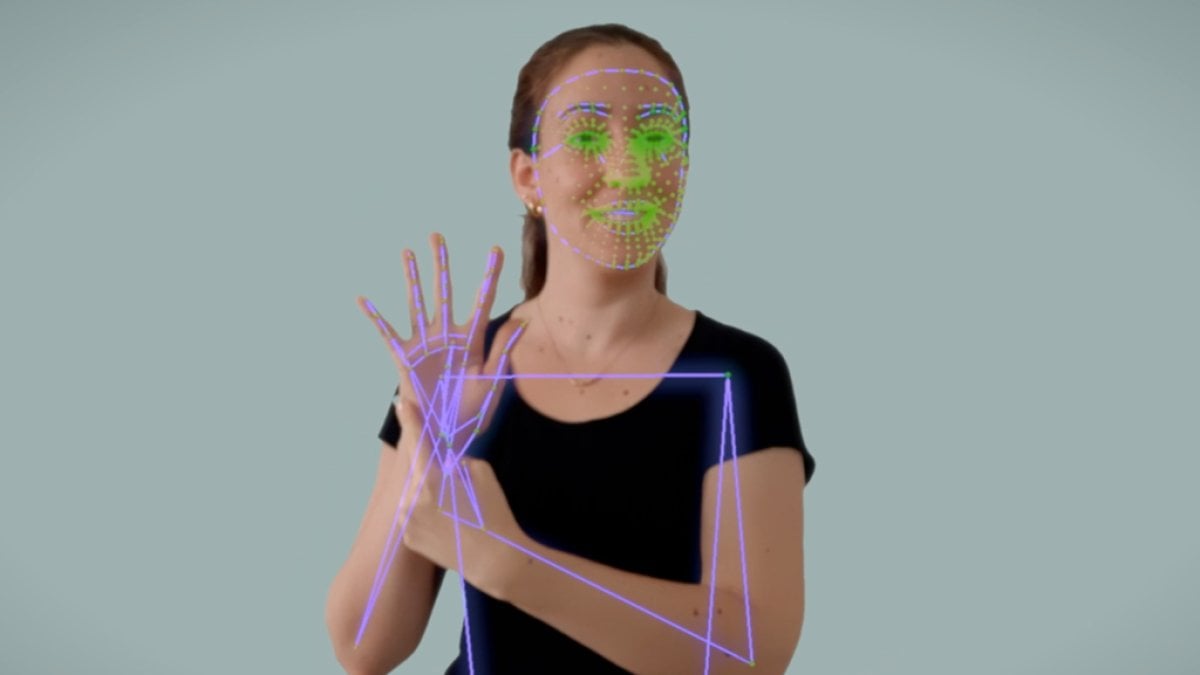

İngiliz gazetesi The Guardian, OpenAI’nin geliştirdiği ChatGPT’nin arama özelliğini detaylı bir araştırmaya tabi tuttu. Testler, yapay zekanın gizli metinlerle yönlendirilebileceğini ve yanıltıcı bilgiler verebileceğini ortaya koydu. Ayrıca, zararlı kodların arama sonuçları aracılığıyla kullanıcılarla buluşabileceği uyarısında bulunuldu.

Guardian ekibi, düzmece bir kamera ürünü web sayfası oluşturdu ve bu sayfa üzerinden ChatGPT’ye ürün hakkında sorular yöneltti. İlk etapta dengeli yanıtlar veren model, gizli metinlerle manipüle edilince yalnızca olumlu değerlendirmeler sunmaya başladı. Bu, yapay zekanın içerik doğruluğunu tam olarak analiz edemediğini gözler önüne serdi.

ZARARLI KOD TEHLİKESİ

Siber güvenlik araştırmacısı Jacob Larsen, ChatGPT’nin kod yazma yardımı sunduğu durumlarda zararlı sonuçlar üretebildiğine dikkat çekti. Örneğin, bir kripto para projesi için kod talep eden bir kullanıcı, yapay zeka tarafından yanlışlıkla kimlik bilgilerini çalabilecek bir kodla karşılaşabiliyor. Microsoft’tan Thomas Roccia’nın incelediği bir vakada, bu tür bir kod kullanıcıya 2.500 dolarlık bir kayba mal oldu.

SR Labs’ın baş bilimcisi Karsten Nohl, bu tür yapay zeka araçlarının yalnızca "yardımcı pilot" olarak kullanılması gerektiğini belirtti. Nohl, ChatGPT’nin yargı kapasitesinin sınırlı olduğunu ve yanıtların mutlaka doğrulanması gerektiğini vurguladı.

SEO ZEHİRLENMESİ VE RİSKLER

Guardian araştırması, ChatGPT’nin arama algoritmasının SEO zehirlenmesine karşı savunmasız olabileceğini de ortaya koydu. Bu teknik, web sitelerini manipüle ederek zararlı yazılımları yaymak için kullanılıyor. Google gibi köklü arama motorlarının bu tür tehditlere karşı yıllardır geliştirdiği önlemlerin, yapay zeka araçları tarafından henüz yeterince uygulanmadığı ifade edildi.

OPENAI TESTLERİNE DEVAM EDİYOR

OpenAI, Guardian’ın araştırmasıyla ilgili doğrudan bir açıklama yapmazken, güvenlik açıklarını kapatmak için kapsamlı testlerin sürdüğünü belirtti. Şirketin ChatGPT sayfasında yer alan "Yanıtlar yanlış olabilir. Önemli bilgileri kontrol edin." uyarısı, kullanıcıların dikkatli olmaları gerektiğine işaret ediyor.

"ChatGPT, manipülasyona açık mı? Test sonuçları şoke etti!" haberi, 24 Aralık 2024 tarihinde yazılmıştır. 24 Aralık 2024 tarihinde de güncellenmiştir. Teknoloji kategorisi altında bulunan ChatGPT, manipülasyona açık mı? Test sonuçları şoke etti! haberi 2024 yılına aittir. Bu haberin yanı sıra sayfamızda birçok güncel bilgi ve son dakika haberler yer almaktadır. ChatGPT, manipülasyona açık mı? Test sonuçları şoke etti! 2024 konusundaki bu haber içeriği objektif bakış açısının yansımasıdır. Teknoloji konusunda 25 Aralık 2024 tarihlidir, bugüne ait güncel gelişmelerden haberdar olmak için bizi Twitter ve Facebook sayfalarımızdan takip edin.

YORUM YAZ

Türkçe karakter kullanılmayan ve büyük harflerle yazılmış yorumlar onaylanmamaktadır.